NEWS | ビジネス

2021.11.30 14:00

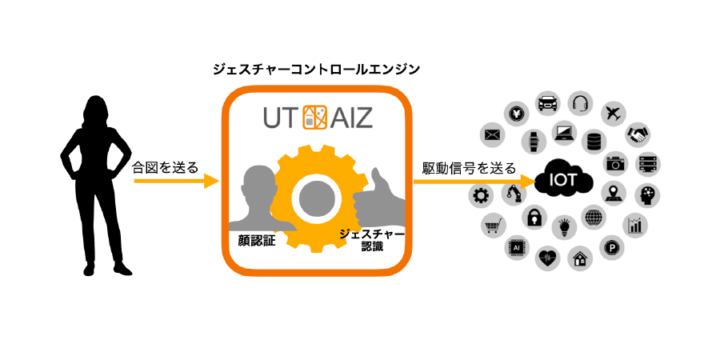

日建設計総合研究所(NSRI)とシーエーシー(CAC)は、ユーザーの合図や動作を感知して機器や装置をコントロールするジェスチャーコントロールエンジン「UT-AIZ™(ユーティーアイズ)」を開発したことを発表した。

私たちの暮らしにおいて、安心安全を実現するためには解決すべき多様な課題が存在する。しかし、こうした課題は画一的なアプローチでカバーすることが難しい。そこで、NSRIは都市に生活する人間が発する「合図(身体動作、ふるまい)」に着目。AIテクノロジーと人間の「合図」を組み合わせ、都市で発生する課題に対して柔軟に対処できる仕組みづくりとして「UT-AIZ™」を開発した。

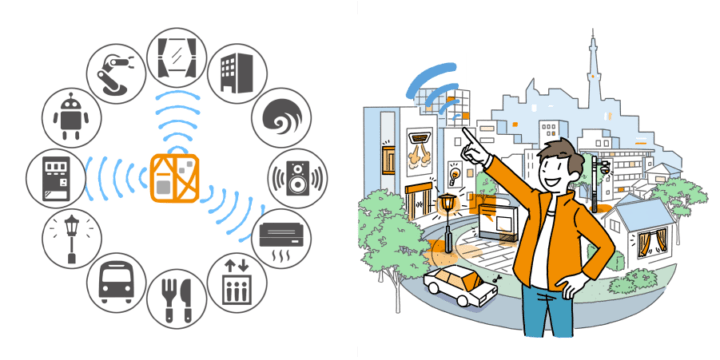

このシステムは、人間の身体動作をAIが認識し、IoT機器・装置の駆動につなげるもの。身振り・手振りだけでなく、口の動きや人間が発するSOSの合図なども読み取ることができるという。また、建築建具や照明器具、空調設備、昇降機設備をはじめ、サイネージやナースコール(病院施設)、外装部材など、さまざまな要素への応用・導入が可能だそうだ。

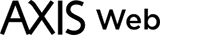

▲UT-AIZ™の仕組み

▲UT-AIZの利用イメージ

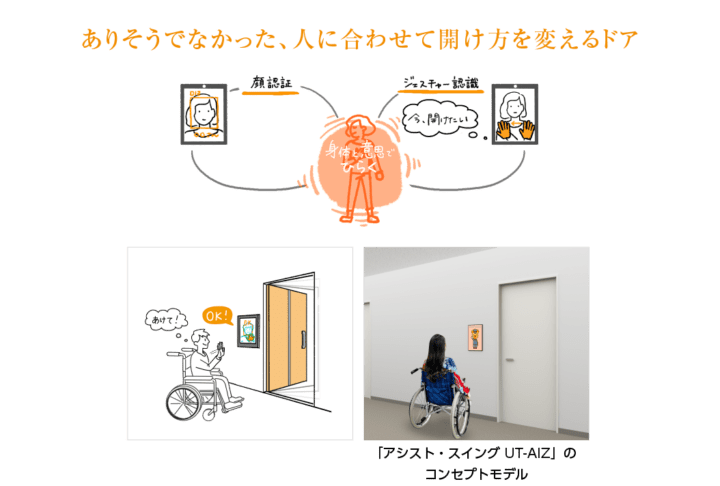

今回はそのサービスモデル第1弾として、「ジェスチャーと顔認証にフォーカスし、あらゆる人が快適・安全にドアを開けること」を可能にする「アシスト・スイング UT-AIZ」のコンセプトモデルを作製。

同モデルは、NSRIとCAC、およびゴールドマンが開発した、ジェスチャーと顔認証で扉を開閉するシステム。人にあわせて何通りもの開き方を選択できるため、障がいを持つ人や要介護者、両手で荷物を持つ人など、これまでドアを開けにくかった人でも快適な通行を可能にする。

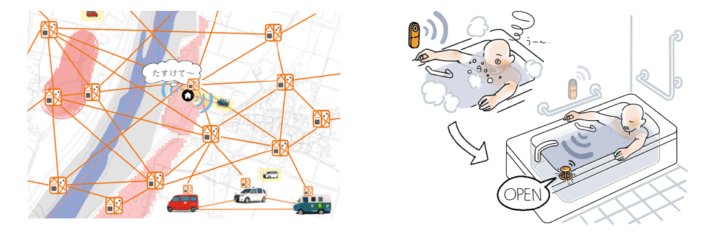

▲身の危険を合図で知らせる

▲体調不良を合図で知らせる/合図で空調をコントロール

▲災害などの有事に地区内の人間の合図をつなげて避難指示に活用する/浴室トラブルなど日常災害の兆候を察知

セキュリティ機能を確保する顔認証技術も実装しているので、カードキーやスマホなどを用いずに安全かつ非接触での入室も実現。オーナーの要望に合わせて機能や合図のカスタマイズができるとしている。![]()